AR眼镜:可视化声音

推荐:将NSDT场景编辑器加入你的3D工具链

3D工具集:NSDT简石数字孪生

音频可以包括各种各样的声音,从人类语音到非语音声音,如狗吠和警笛声。在为有听力障碍的人设计可访问的应用程序时,应用程序应该能够识别声音并理解语音。

这种技术将帮助聋哑人或听力障碍者可视化语音,如人类对话和非语音。将语音和声音AI结合在一起,您可以将可视化效果叠加到AR眼镜上,使用户能够看到和解释他们无法听到的声音。

根据世界卫生组织的数据,约有1.5B人(占全球人口的近20%)患有听力损失。到2年,这个数字可能会上升到5.2050B。

Cochl 是位于圣何塞的 NVIDIA 合作伙伴,是一家深度技术初创公司,使用声音 AI 技术来理解任何类型的音频。他们还是 NVIDIA Inception 计划的成员,该计划通过提供尖端技术和 NVIDIA 专家的访问,帮助初创公司更快地构建解决方案。

该平台可以识别37种环境声音,该公司通过添加尖端的语音转文本技术更进一步。这让我们对声音世界有了真正完整的理解。

AR眼镜可可视化任何声音AR眼镜有可能极大地改善听力损失者的生活,作为一种可视化声音的可访问工具。这项技术可以帮助提高他们的沟通能力,使他们更容易导航和参与周围的世界。

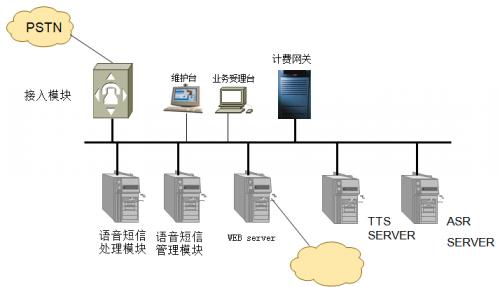

在此方案中,自动语音识别 (ASR) 用于使眼镜能够识别和理解人类语音。这项技术可以通过多种方式集成到眼镜中:

使用麦克风捕获与聋哑人或听力障碍者交谈的人的语音,然后使用 ASR 算法将语音解释并转录为文本。然后,该文本可以显示在眼镜上,使聋哑人或听力障碍者能够阅读和理解语音。

ASR还可用于使眼镜能够响应语音命令,以便用户可以通过语音控制眼镜。

他们还能够在屏幕上显示所有对话,例如在您开车时从地图转录语音方向,以及任何其他声音,如紧急车辆的喇叭或警报声和风噪。

Cochl 使用 NVIDIA Riva 在其软件堆栈中为其 ASR 功能提供支持。Riva 是一个 GPU 加速、完全可定制的 SDK,用于开发语音 AI 应用程序。通过使用丽娃,该平台已经能够扩展其理解各种声音的能力,包括非语音声音。

“我们已经测试了许多语音识别服务,但只有丽娃提供了异常高和稳定的实时性能。所以现在我们可以让我们的声音人工智能系统更接近人类的听觉感知,“Cochl的联合创始人兼首席执行官Yoonchang Han说。

“正如我们所观察到的,AR眼镜最有可能用于环境嘈杂的开放空间。NVIDIA Riva 帮助我们即使在嘈杂的环境中也能准确转录语音,并为我们提供了无缝体验,可以集成到我们的 Cochl.Sense 平台中。

辅助技术的未来创建一个像人类一样感知声音的通用人工智能系统是一个巨大的挑战。为了使AR眼镜更容易获得,需要更轻的可穿戴技术。

然而,在这一点上,它们仍然是将声音和语音转换为视觉信息的理想媒介。通过集成机器聆听功能,AR眼镜可以为世界各地的聋哑人或听力障碍者带来更安全、更方便、更愉快的日常生活。

Cochl还在探索语音AI的更多用例,例如为AR眼镜上的任何视频提供隐藏式字幕,以及可视化多说话人转录。为了给有听力障碍的人提供最佳体验,他们正在探索分析和可视化音乐的方法,以帮助他们至少理解音乐的流派和情感。

他們很高興嘗試更多 NVIDIA 解決方案,包括 Riva、NVIDIA NeMo 和 NVIDIA TensorRT。

原文链接:AR眼镜:可视化声音 (mvrlink.com)

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。