Nature调查:1600余名科学家,仅4%认为AI当前是“必需品”

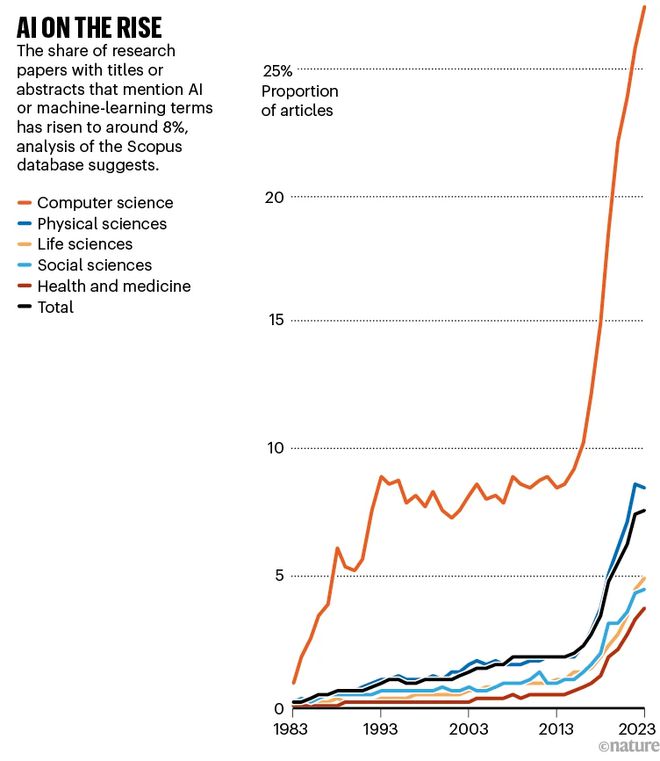

过去十年,关于人工智能(AI)的研究论文数量在各个领域都有显著增加。

本文引用地址:http://www.amcfsurvey.com/article/202310/451310.htm科学家们已经开始运用 AI 工具来协助总结和撰写研究论文和编写代码。一些研究者尝试借助生成式 AI 技术来探索新的领域,如蛋白质结构的发现、天气预报的改进以及医学诊断的创新等各种有前景的领域。

AI 已然渗透到科学研究中。那么,科学家们是如何看待它们的?

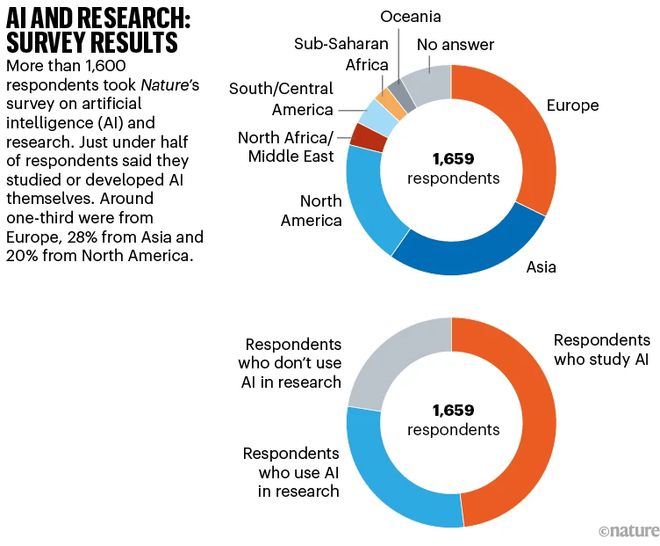

近日,顶级期刊《自然》(Nature)对全球 1600 多名研究人员进行了一项调查。结果表明,AI 工具在科学领域越来越常见,并且许多科学家预计它们将很快成为研究实践的核心。另外,超过一半的受访者认为 AI 工具将在未来十年内变得非常重要或必不可少。

相关调查结果以“AI and science: what 1,600 researchers think”为题,已发表在Nature上。

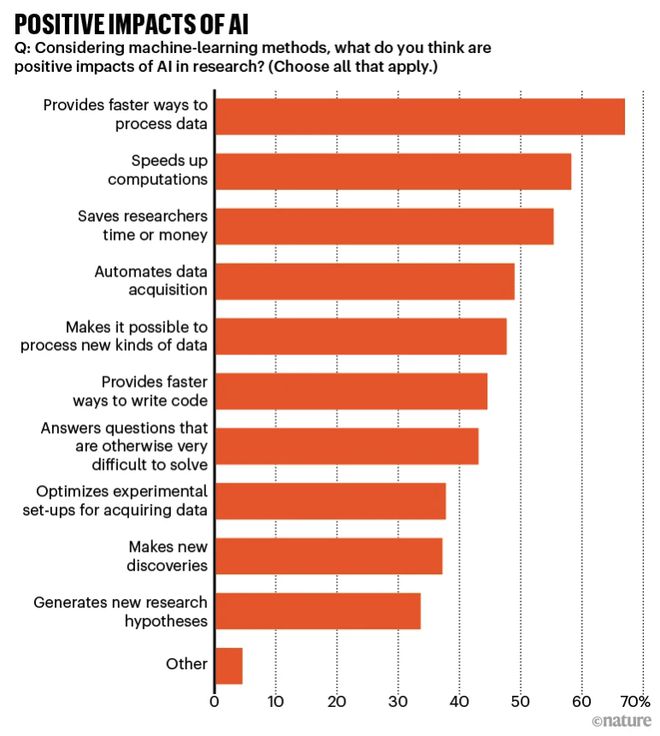

在这项调查中,有 2/3 的受访者认为 AI 提供了更快的数据处理方式,58% 的人认为 AI 加速了以前不可行的计算,55% 的人则提到 AI 节省了时间和金钱。

来自杜克大学的计算生物学家 Irene Kaplow 表示:“AI 让我能够在以前难以攻克的生物学问题中取得进展。”

然而,也有 69% 的研究人员表示,AI 工具可能导致更多地依赖模式识别而不是深刻理解,58% 的人认为 AI 可能会在数据中强化偏见或歧视,55% 认为这些工具可能会增加欺诈的发生概率,53% 的人指出草率使用可能会导致研究无法重现。

任职康涅狄格州的杰克逊实验室、从事癌症图像分析的 Jeffrey Chuang 表示:“主要问题在于 AI 正在挑战我们现有的证据和真相标准。”

科学家的担忧与兴奋

为了评估活跃研究人员的观点,《自然》杂志通过电子邮件联系了在 2022 年最后 4 个月内发表论文的 4 万多名科学家,并邀请《自然简报》的读者参与调查。

在这些受访者中,48% 的人直接开发或研究 AI,30% 的人在研究中使用了 AI,剩下的 22% 的人在科学中没有使用 AI。

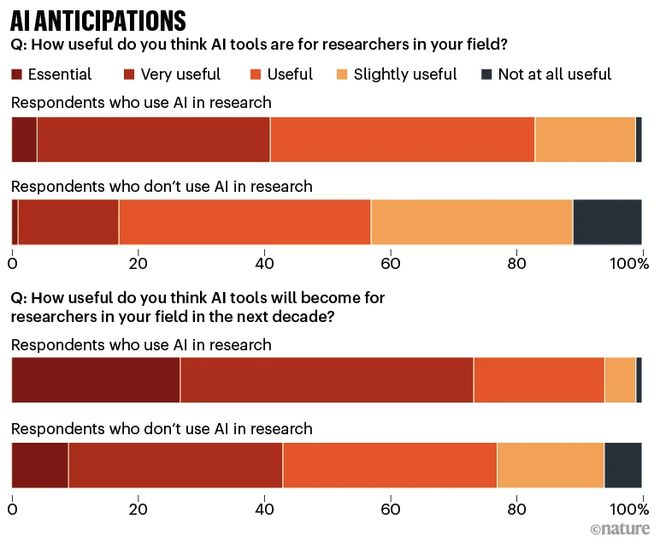

在那些在研究中使用 AI 的人中,超过 1/4 的人认为 AI 工具将在未来十年内变得必不可少,而认为 AI 工具现在是“必需品”的人只占 4%。另有 47% 的人认为 AI 将变得非常有用。然而,不使用 AI 的研究人员对此并不太感兴趣。即便如此,仍然有 9% 的人认为这些技术将在未来十年内变得必不可少,另有 34% 的人表示它们将非常有用。

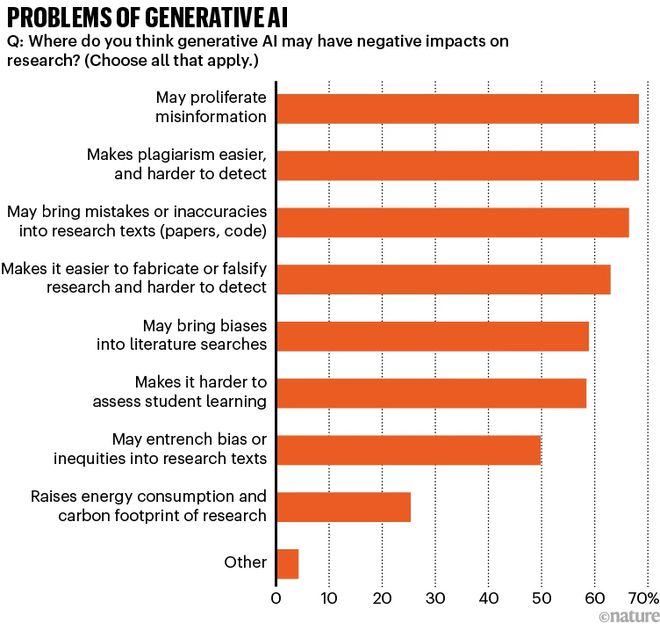

当被要求从可能的生成式 AI 负面影响列表中选择时,68% 的研究人员担心信息传播不准确,另有 68% 的人认为这将使抄袭更容易,检测更难,66% 的人担心会引入错误或不准确的内容到研究论文中。

此外,受访者还提到,如果用于医学诊断的 AI 工具是基于具有历史偏见的数据进行训练,他们担心会出现伪造研究、虚假信息和偏见。科学家们已经看到了这方面的证据:例如,美国的一个团队报告说,当他们要求 GPT-4 为临床案例研究提供诊断和治疗建议时,答案会根据患者的种族或性别而变化。

英国布里斯托尔大学攻读医学 AI 博士学位的软件工程师和前企业家 Isabella Degen 表示:“大型语言模型(LLMs)被滥用,存在不准确和虚假但听起来专业的结果。在我看来,我们对于正确使用和滥用之间的界限认识还不够清晰。”

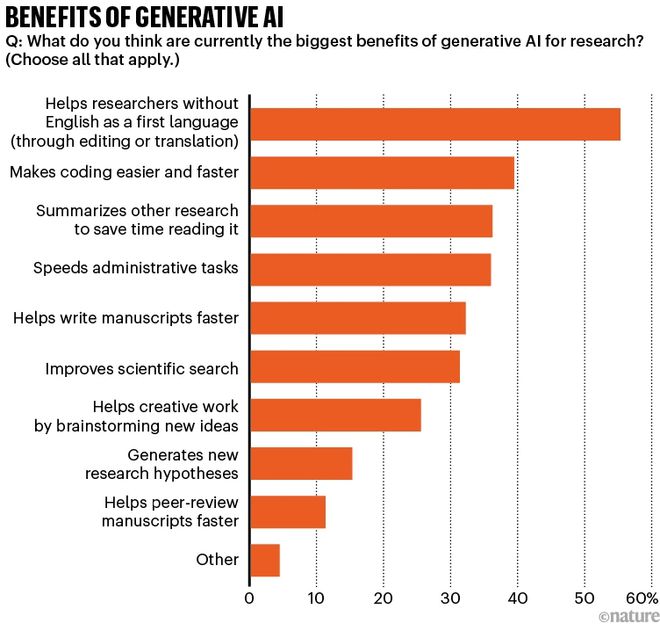

研究人员认为,最明显的好处是 LLMs 可以帮助非英语母语的研究人员,改进他们研究论文的语法和风格,总结或翻译其他工作。新加坡国立大学材料科学家 Kedar Hippalgaonkar 指出,“尽管存在一小部分恶意玩家,但学术界可以展示如何善用这些工具。”

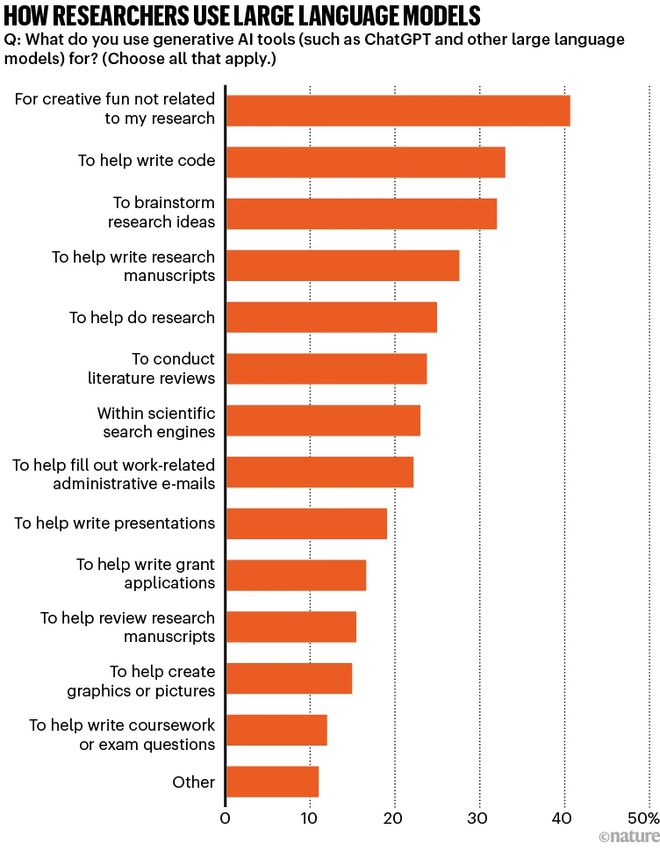

即使在对 AI 感兴趣的研究人员中,经常在工作中使用 LLMs 的研究人员也仍占少数。那些学习AI 的人中有 28% 表示每天或每周使用生成式 AI 产品,而仅使用 AI 的人中有 13% 这样做,而其他人中只有 1%,尽管许多人至少尝试过这些工具。此外,所有群体中最流行的用途是与研究无关的创意娱乐;较少一部分人使用这些工具来编写代码、构思研究思路和帮助撰写研究论文。

另外,一些科学家对 LLMs 的输出并不满意。一位使用 LLMs 来帮助编辑论文的研究人员写道:“ChatGPT 好像复制了人类的所有不良写作习惯。”芬兰图尔库大学的物理学家 Johannes Niskanen 则表示:“如果我们开始使用 AI 来阅读和撰写文章,科学很快就会从‘由人类为人类(for humans by humans)’转变为‘由机器为机器(‘for machines by machines)’。”

AI 发展面临困境

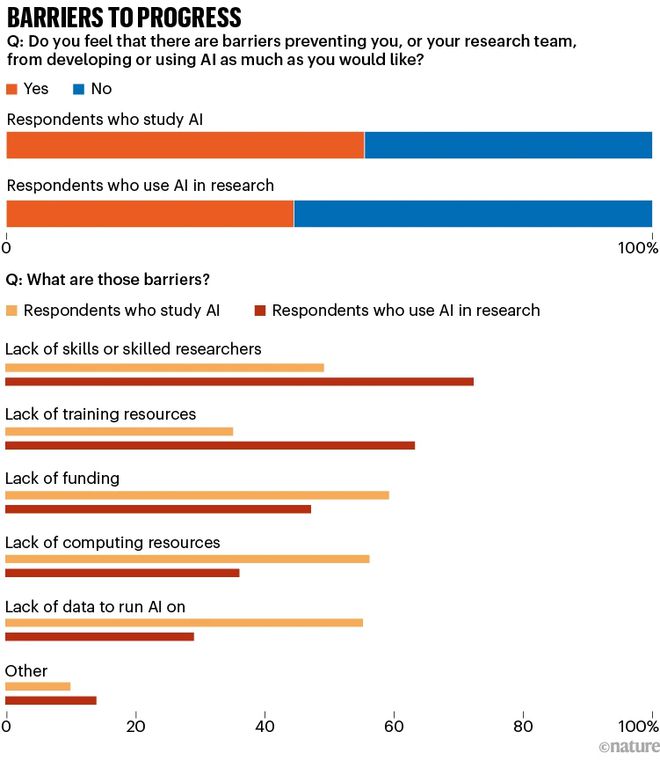

在这项调查中,大约一半的科学家表示他们在开发或使用 AI 方面遇到了阻碍。直接研究 AI 的研究人员最担心的问题包括计算资源不足、为其工作提供的融资不足以及获取运行 AI 所需的高质量数据不足。而那些在其他领域工作但在研究中使用 AI 的人则更担心缺乏熟练的科学家和训练资源,此外,他们还提到了安全和隐私方面的考虑。然而,不使用 AI 的研究人员表示他们不需要 AI 或认为它不实用,或者缺乏研究 AI 的经验和时间。

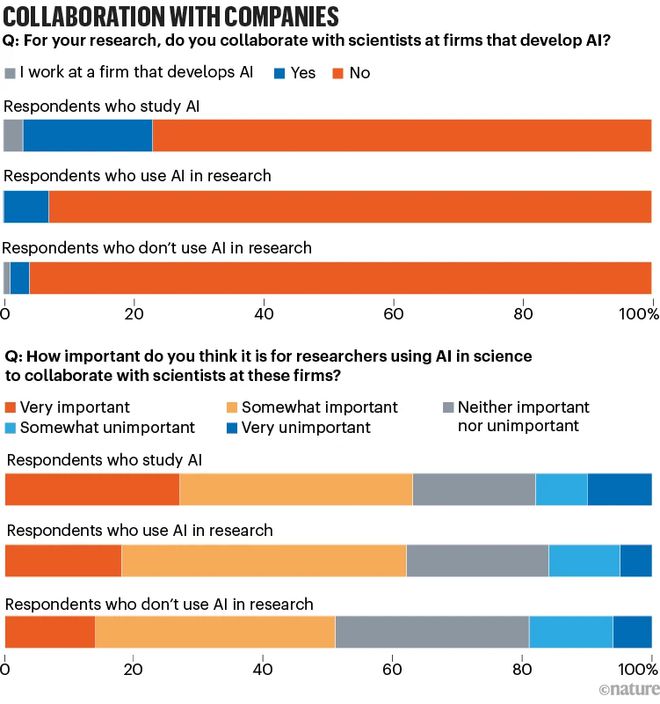

调查中出现的另一个主题是商业公司主导了 AI 的计算资源和 AI 工具的所有权。研究 AI 的科学家中有 23% 表示他们与开发这些工具的公司合作或在这些公司工作(其中最常提到的是谷歌和微软),而使用 AI 的人中只有 7% 这样做。总体而言,略多于一半的受访者认为,使用 AI 的研究人员与这些公司的科学家合作是非常重要或有些重要的。

此前,已有研究人员多次警告称,科学中对 AI 工具的天真使用可能导致错误、虚假阳性和无法重现的研究结果,从而潜在地浪费时间和精力。一些科学家表示,他们担心使用 AI 的论文中存在质量不佳的研究。

堪萨斯州立大学曼哈顿分校的计算机科学家 Lior Shamir 表示,“机器学习有时可能有用,但 AI 引发的问题比帮助多。科学家在不了解自己在做什么的情况下使用 AI,可能会导致虚假的发现。”

当问及期刊编辑和同行评审人是否能够充分审查使用 AI 的论文时,受访者意见不一。在那些使用 AI 进行工作但不直接开发 AI 的科学家中,大约一半表示不知道, 1/4 认为审查是充分的,1/4 认为不充分。直接开发 AI 的人倾向于对编辑和审查过程持更积极的看法。

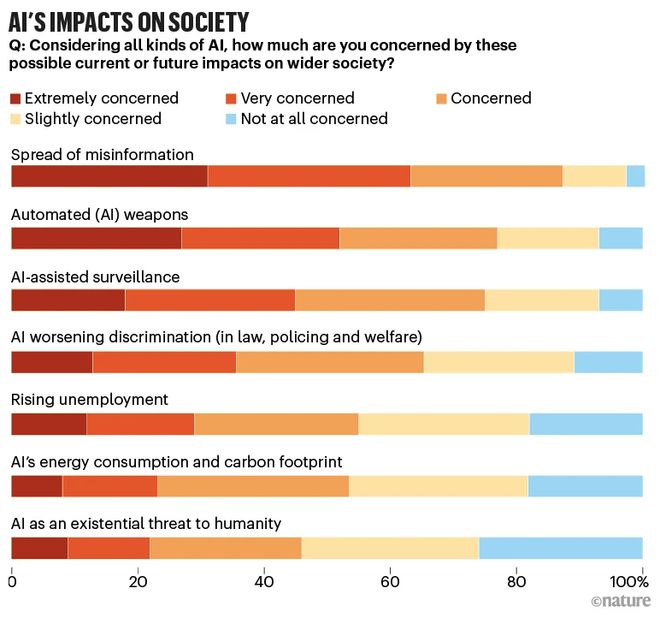

另外,《自然》还询问了受访者对于 AI 在社会的 7 种潜在影响的担忧程度,2/3 的人表示他们对此非常担忧或很担忧。自动化 AI 武器和 AI 辅助监视也高居榜首,最不令人担忧的是 AI 可能对人类构成生存威胁的想法。

然而,许多研究人员表示,AI 和 LLMs 已经成为不可回避的趋势。波士顿马萨诸塞州贝斯以色列圣救主医疗中心的肝病专家 Yury Popov 写道:“AI 是具有变革性的,我们现在必须关注如何确保它带来更多的好处,而不是问题。”

评论